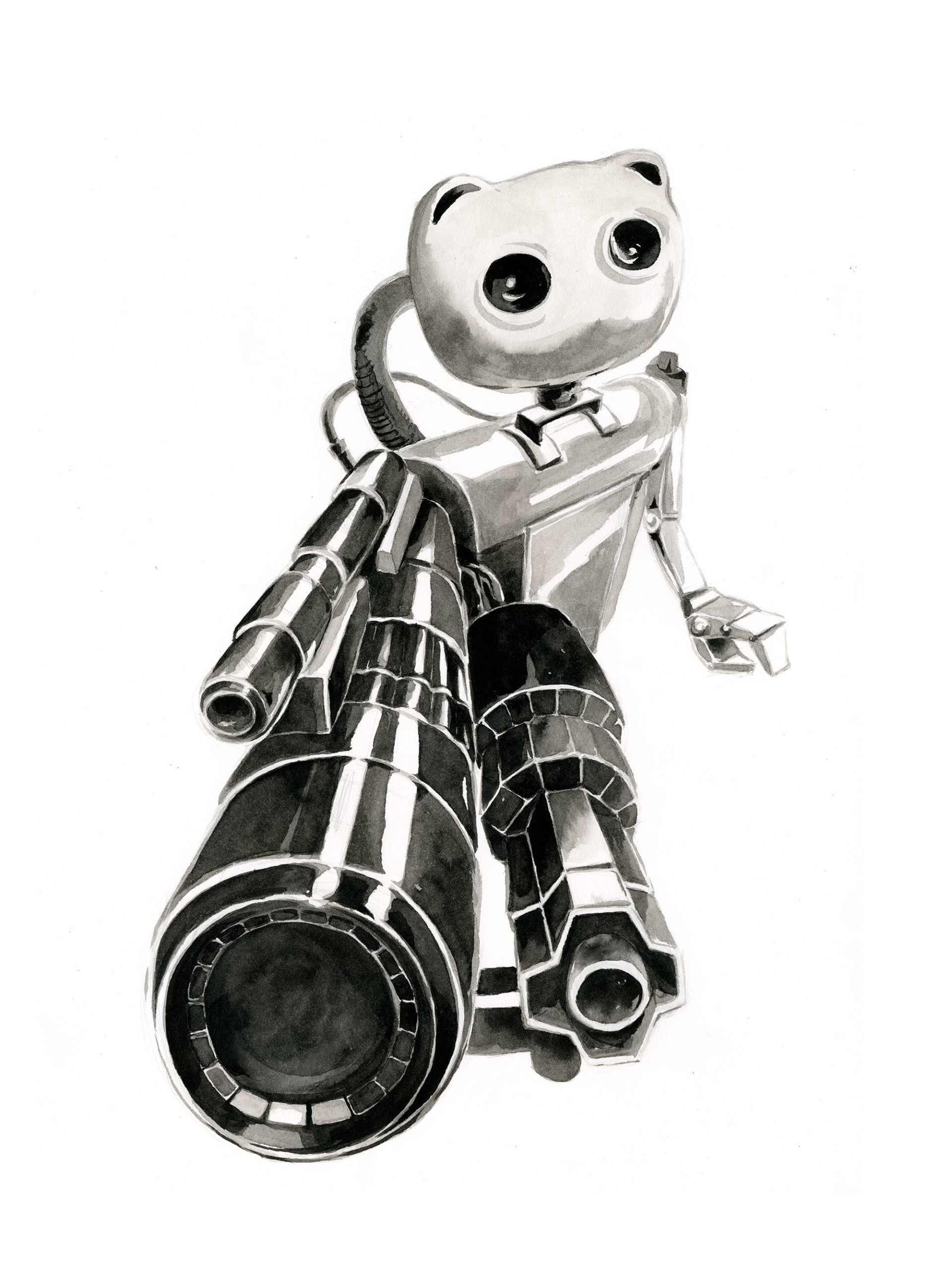

”Se joka hallitsee tekoälyä, hallitsee maailmaa”, totesi Venäjän presidentti Vladimir Putin vuonna 2017. Putin viittasi tällä robotteihin, jotka on ohjelmoitu tuhoamaan. Hollantilainen PAX-rauhanjärjestö julkaisi marraskuussa raportin, josta ilmenee, että yhä suurempi osa aseteknologiaa kehittävistä yrityksistä kehittää autonomisia asejärjestelmiä. Tämä tarkoittaa tekniikkaa, jossa asejärjestelmä pystyy suorittamaan tehtäviä itsenäisesti – kuten havainnoimaan ympäristöä ja paikantamaan kohteita. Tähän mennessä tekniikkaa on käytetty lähinnä puolustuskäytössä kuten ohjusten torjunnassa. Tulevaisuudessa järjestelmät pystyvät kuitenkin toimimaan yhä itsenäisemmin, jolloin niitä voidaan käyttää tehokkaasti myös hyökkäyksiin. Tekoälyyn perustuva teknologia tulee yleistymään tulevaisuudessa yhteiskunnan eri sektorilla kuten hoiva-alalla ja liikenteessä. Mutta miten käy, kun roboteille annetaan aseet? Robottiaseiden vastaisen

Ylivertainen ase kiinnostaa suurvaltoja. Johtavat tutkijat pelkäävät hetkeä, jolloin tekoälylle annetaan lupa tappaa.

Terminaattorit ja robocopit saattavat olla pian todellisuutta. Asevalmistajat kehittävät kilpaa robotiikkaan ja tekoälyyn perustuvaa aseteknologiaa. Tulevaisuudessa päätös tappamisesta voi hyvin perustua algoritmeille eikä ihmisen yksittäiseen päätökseen. Teknologinen vallankumous tulee muuttamaan sodankäyntiä yhtä merkittävästi kuin ruudin keksiminen aikanaan.